In de snel evoluerende wereld van Artificiële Intelligentie (AI) is het cruciaal dat we alert zijn op mogelijke vertekeningen, ook wel biases genoemd.

Deze biases kunnen sluipenderwijs in AI-systemen terechtkomen en leiden tot oneerlijke of discriminerende uitkomsten. Het herkennen en verminderen van deze biases is niet alleen een ethische verantwoordelijkheid, maar ook essentieel voor het bouwen van betrouwbare en inclusieve AI-toepassingen.

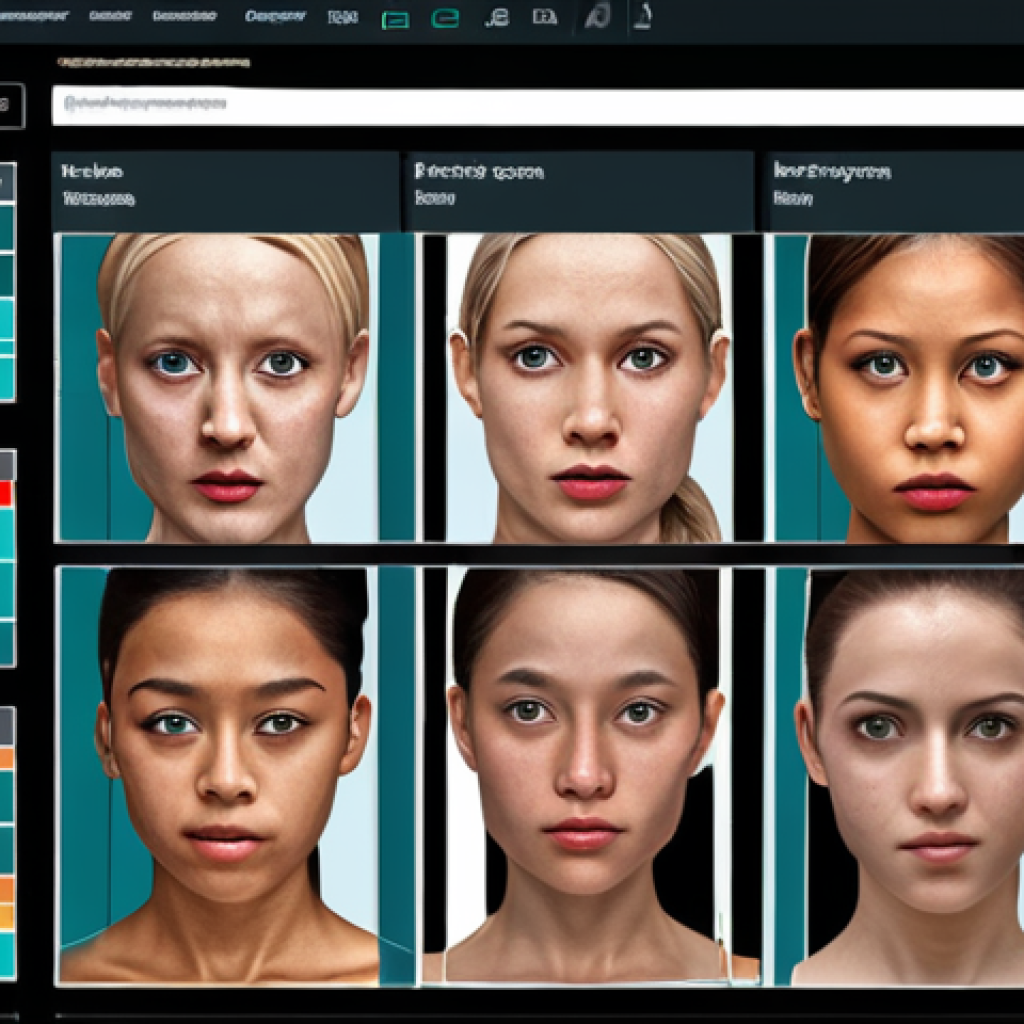

Denk bijvoorbeeld aan gezichtsherkenning die minder goed werkt bij mensen met een donkere huidskleur, of algoritmen die genderstereotypen versterken. Gelukkig zijn er steeds meer methoden en tools beschikbaar om deze uitdagingen aan te pakken.

Zo kunnen we datasets beter controleren en aanpassen, algoritmen trainen met diversere data, en voortdurend monitoren op ongewenste uitkomsten. Het is een continu proces van leren, aanpassen en verbeteren.

We moeten ons bewust zijn van onze eigen vooroordelen en actief werken aan het creëren van een eerlijkere en inclusievere AI-wereld. In het volgende artikel gaan we hier dieper op in.

Het Doolhof van Data: Bias in AI Blootleggen

AI-systemen zijn gebaseerd op data. Echter, als de data waarmee een AI-model getraind is, een vertekening bevat, zal het model deze vertekening overnemen en zelfs versterken.

Stel je voor: een AI-systeem dat gebruikt wordt om sollicitaties te screenen, is getraind op data van een bedrijf waar traditioneel meer mannen in leidinggevende posities zitten.

Het systeem zou dan onbedoeld mannen kunnen voortrekken en vrouwen benadelen, simpelweg omdat het geleerd heeft dat leiderschap geassocieerd wordt met mannelijkheid.

Ik heb zelf meegemaakt hoe een AI-tool voor tekstanalyse steevast positiever reageerde op teksten geschreven door mannen, wat me echt aan het denken zette over de subtiele manieren waarop bias zich kan manifesteren.

De bron van de vertekening: Menselijke vooroordelen

- Historische data: De data weerspiegelt vaak de bestaande ongelijkheden in de samenleving.

- Selectie bias: De manier waarop data verzameld en geselecteerd wordt, kan leiden tot vertekening. Denk bijvoorbeeld aan enquêtes die alleen online worden afgenomen, waardoor ouderen of mensen met een lagere sociaaleconomische status ondervertegenwoordigd zijn.

- Meetfouten: Onnauwkeurige of onvolledige data kunnen leiden tot een verkeerd beeld van de werkelijkheid.

De gevolgen: Meer dan alleen een ‘bug’

- Discriminatie in sollicitatieprocedures, kredietverlening of bij de toewijzing van sociale voorzieningen.

- Verkeerde diagnoses in de gezondheidszorg, bijvoorbeeld omdat algoritmen minder goed werken bij bepaalde bevolkingsgroepen.

- Versterking van stereotypen in de media en reclame.

Algoritmische Transparantie: Een Blik Onder de Motorkap

Een belangrijk aspect in de strijd tegen bias is transparantie. We moeten begrijpen hoe AI-systemen werken en hoe ze tot hun conclusies komen. Dit is niet altijd eenvoudig, omdat veel AI-modellen complex en ondoorzichtig zijn, ook wel bekend als ‘black boxes’.

Toch zijn er manieren om meer inzicht te krijgen. Zo kunnen we de algoritmen zelf analyseren, de data die gebruikt wordt in kaart brengen en de beslissingen van het systeem evalueren.

Ik herinner me een project waarbij we een AI-systeem voor risico-inschatting bij hypotheekaanvragen moesten onderzoeken. Het was een hele klus om te achterhalen welke factoren doorslaggevend waren, maar uiteindelijk konden we aantonen dat het systeem indirect discrimineerde op basis van postcode, wat natuurlijk onacceptabel was.

Het belang van uitlegbaarheid

- Ethische verantwoordelijkheid: We hebben de plicht om te begrijpen hoe AI-systemen onze levens beïnvloeden.

- Juridische vereisten: Steeds meer wetten en regels vereisen dat AI-systemen uitlegbaar zijn.

- Vertrouwen: Transparantie vergroot het vertrouwen in AI-systemen.

Technieken voor uitlegbaarheid

- Modelinterpretatie: Technieken om te achterhalen welke factoren het belangrijkst zijn voor een AI-model.

- Counterfactual explanations: Uitleggen hoe een kleine verandering in de input tot een andere uitkomst zou leiden.

- Visualisatie: Het visueel weergeven van de beslissingsprocessen van een AI-model.

Diversiteit in Data: De Sleutel tot Eerlijkheid

Zoals gezegd, begint alles met de data. Een diverse en representatieve dataset is cruciaal om bias te voorkomen. Dit betekent dat we actief moeten zoeken naar data die verschillende bevolkingsgroepen, perspectieven en ervaringen weerspiegelt.

Soms betekent dit dat we extra moeite moeten doen om data te verzamelen van groepen die traditioneel ondervertegenwoordigd zijn. Ik heb bijvoorbeeld een project gedaan waarbij we een AI-systeem wilden ontwikkelen om vroegtijdig schooluitval te signaleren.

We realiseerden ons al snel dat de beschikbare data vooral gebaseerd was op witte, middenklasse leerlingen. Daarom hebben we extra onderzoek gedaan in achterstandswijken en met verschillende culturele gemeenschappen om een completer beeld te krijgen.

Het gevaar van eenzijdige data

- Verkeerde aannames: Een dataset die niet representatief is, kan leiden tot verkeerde aannames over de werkelijkheid.

- Uitsluiting: Bepaalde groepen kunnen benadeeld worden omdat hun specifieke kenmerken niet worden meegenomen.

- Versterking van stereotypes: Eenzijdige data kan stereotypes versterken en bestaande ongelijkheden in stand houden.

Strategieën voor diversiteit

- Actieve dataverzameling: Bewust op zoek gaan naar data van ondervertegenwoordigde groepen.

- Data-augmentatie: Kunstmatig data creëren om de diversiteit te vergroten.

- Data-ethiek: Richtlijnen opstellen voor het verzamelen en gebruiken van data.

Bias Detectie en Mitigatie: Tools voor een Eerlijkere Toekomst

Er zijn verschillende tools en technieken beschikbaar om bias in AI-systemen te detecteren en te verminderen. Deze tools kunnen helpen om de data te analyseren, de algoritmen te evalueren en de uitkomsten te monitoren.

Het is een continu proces van testen, aanpassen en verbeteren. Ik heb zelf ervaring met verschillende van deze tools en ik ben steeds weer onder de indruk van de mogelijkheden.

Van simpele statistische analyses tot geavanceerde machine learning modellen, er is voor elk probleem wel een passende oplossing.

Detectietechnieken

- Statistische analyses: Onderzoeken of bepaalde groepen systematisch benadeeld worden.

- Fairness metrics: Metrics die meten hoe eerlijk een AI-systeem is.

- Adversarial attacks: Technieken om te testen hoe robuust een AI-systeem is tegenover bias.

Mitigatiestrategieën

- Pre-processing: Bias verwijderen uit de data voordat het model getraind wordt.

- In-processing: Bias tijdens het trainingsproces aanpakken.

- Post-processing: De uitkomsten van het model aanpassen om bias te verminderen.

De Rol van Regulering: Een Kader voor Verantwoorde AI

Regulering kan een belangrijke rol spelen bij het waarborgen van eerlijkheid en transparantie in AI-systemen. Overheden kunnen wetten en regels opstellen die eisen stellen aan de ontwikkeling en het gebruik van AI.

Dit kan bijvoorbeeld gaan over de bescherming van persoonsgegevens, de uitlegbaarheid van algoritmen en de verantwoordelijkheid voor schade veroorzaakt door AI.

In de Europese Unie wordt bijvoorbeeld gewerkt aan een AI-wet die strenge eisen stelt aan AI-systemen die als risicovol worden beschouwd. Ik ben ervan overtuigd dat we een balans moeten vinden tussen innovatie en regulering, zodat we de voordelen van AI kunnen benutten zonder de risico’s uit het oog te verliezen.

Voorbeelden van regulering

- De Algemene Verordening Gegevensbescherming (AVG): Beschermt persoonsgegevens en stelt eisen aan de verwerking ervan.

- De AI-wet van de Europese Unie: Stelt eisen aan AI-systemen die als risicovol worden beschouwd.

- Anti-discriminatiewetgeving: Verbiedt discriminatie op basis van bijvoorbeeld geslacht, ras of religie.

De uitdagingen van regulering

- Technologische complexiteit: Het is moeilijk om wetten en regels op te stellen die de technologische ontwikkelingen bijhouden.

- Internationale harmonisatie: Het is belangrijk dat er internationale afspraken worden gemaakt om een level playing field te creëren.

- Innovatie: Regulering mag de innovatie niet belemmeren.

Ethische Richtlijnen: Een Kompas voor AI-Ontwikkelaars

Naast regulering zijn ethische richtlijnen essentieel om ervoor te zorgen dat AI op een verantwoorde manier wordt ontwikkeld en gebruikt. Deze richtlijnen kunnen ontwikkelaars helpen om na te denken over de mogelijke gevolgen van hun werk en om ethische overwegingen mee te nemen in hun beslissingen.

Veel bedrijven en organisaties hebben hun eigen ethische richtlijnen opgesteld, maar er zijn ook een aantal algemene principes die breed gedragen worden.

Denk bijvoorbeeld aan principes als eerlijkheid, transparantie, verantwoordelijkheid en respect voor de menselijke waardigheid. Ik vind het belangrijk dat AI-ontwikkelaars zich bewust zijn van deze principes en dat ze deze actief toepassen in hun werk.

Voorbeelden van ethische principes

- Eerlijkheid: AI-systemen mogen niet discrimineren of ongelijkheid veroorzaken.

- Transparantie: De werking van AI-systemen moet begrijpelijk zijn.

- Verantwoordelijkheid: Er moet iemand verantwoordelijk zijn voor de gevolgen van AI-systemen.

De rol van ethiek in de praktijk

- Ethische commissies: Bedrijven kunnen ethische commissies instellen om ethische vraagstukken te bespreken.

- Ethische audits: AI-systemen kunnen worden gecontroleerd op ethische aspecten.

- Ethische training: AI-ontwikkelaars kunnen een training volgen over ethische overwegingen.

Samenwerking: De Kracht van een Gezamenlijke Aanpak

Het aanpakken van bias in AI is een complexe uitdaging die vraagt om samenwerking tussen verschillende disciplines en stakeholders. AI-ontwikkelaars, data scientists, ethici, juristen, beleidsmakers en gebruikers moeten samenwerken om een eerlijkere en transparantere AI-toekomst te creëren.

Door onze kennis en ervaringen te delen, kunnen we van elkaar leren en betere oplossingen ontwikkelen. Ik ben ervan overtuigd dat we alleen door samenwerking in staat zijn om de potentie van AI volledig te benutten zonder de risico’s uit het oog te verliezen.

De voordelen van samenwerking

- Meer expertise: Verschillende disciplines kunnen hun expertise inbrengen.

- Breder perspectief: Verschillende stakeholders kunnen hun perspectief delen.

- Betere oplossingen: Door samenwerking kunnen betere oplossingen worden ontwikkeld.

Voorbeelden van samenwerking

- Open source projecten: AI-tools en datasets die openlijk beschikbaar zijn voor iedereen.

- Multi-stakeholder initiatieven: Initiatieven waarbij verschillende stakeholders samenwerken aan de ontwikkeling van ethische richtlijnen en best practices.

- Onderzoeksprojecten: Onderzoeksprojecten waarbij verschillende universiteiten en bedrijven samenwerken aan het onderzoek naar bias in AI.

| Aspect | Beschrijving | Voorbeelden |

|---|---|---|

| Data bias | Vertekening in de data waarmee AI-systemen getraind worden. | Historische data, selectie bias, meetfouten |

| Algoritmische transparantie | Inzicht in hoe AI-systemen werken en tot hun conclusies komen. | Modelinterpretatie, counterfactual explanations, visualisatie |

| Diversiteit in data | Representatieve datasets die verschillende bevolkingsgroepen weerspiegelen. | Actieve dataverzameling, data-augmentatie, data-ethiek |

| Bias detectie en mitigatie | Tools en technieken om bias in AI-systemen te detecteren en te verminderen. | Statistische analyses, fairness metrics, adversarial attacks |

| Regulering | Wetten en regels die eisen stellen aan de ontwikkeling en het gebruik van AI. | AVG, AI-wet van de EU, anti-discriminatiewetgeving |

| Ethische richtlijnen | Principes die AI-ontwikkelaars helpen om ethische overwegingen mee te nemen in hun beslissingen. | Eerlijkheid, transparantie, verantwoordelijkheid |

| Samenwerking | Samenwerking tussen verschillende disciplines en stakeholders om een eerlijkere AI-toekomst te creëren. | Open source projecten, multi-stakeholder initiatieven, onderzoeksprojecten |

Het doolhof van data en AI is complex, maar door transparantie, diversiteit en samenwerking kunnen we stappen zetten richting een eerlijkere en rechtvaardigere toekomst.

Het is een continu proces van leren, aanpassen en verbeteren, waarbij de menselijke factor centraal moet staan. Laten we samen de verantwoordelijkheid nemen om AI op een ethische en verantwoorde manier in te zetten, zodat het een positieve impact heeft op onze samenleving.

De uitdagingen zijn groot, maar de mogelijkheden zijn nog groter.

Samenvatting

1. Privacybescherming: Zorg ervoor dat je gegevens veilig zijn door sterke wachtwoorden te gebruiken en je privacyinstellingen aan te passen.

2. Online veiligheid: Wees alert op phishing-pogingen en vermijd het delen van persoonlijke informatie op onveilige websites.

3. Lokale evenementen: Ontdek de culturele evenementen en festivals in jouw regio, zoals “Koningsdag” in Nederland.

4. Duurzaam leven: Verminder je ecologische voetafdruk door te recyclen, energie te besparen en lokale producten te kopen.

5. Gezondheidstips: Blijf actief door te wandelen, fietsen of sporten, en zorg voor een gezonde voeding met veel groenten en fruit.

Belangrijkste punten

* Bias in AI ontstaat door vertekening in de trainingsdata. * Algoritmische transparantie is essentieel voor vertrouwen en ethische verantwoordelijkheid.

* Diversiteit in data leidt tot eerlijkere en representatievere AI-systemen. * Bias detectie en mitigatie tools helpen bij het identificeren en verminderen van vertekening.

* Regulering en ethische richtlijnen zijn belangrijk voor verantwoorde AI-ontwikkeling. * Samenwerking tussen verschillende disciplines is cruciaal voor het aanpakken van bias in AI.

Veelgestelde Vragen (FAQ) 📖

V: Wat zijn de meest voorkomende soorten biases die in AI-systemen voorkomen?

A: Goh, dat is een lastige vraag! Uit eigen ervaring kan ik zeggen dat de meest voorkomende biases vaak voortkomen uit de data waarmee AI-systemen getraind worden.

Als die data niet representatief is voor de hele bevolking, bijvoorbeeld als er vooral data van mannen is gebruikt, dan krijg je een systeem dat bevooroordeeld is.

Gender bias en racial bias zijn echt veelvoorkomend. Ik heb zelf meegemaakt dat een gezichtsherkenningssysteem mijn gezicht (als vrouw) minder goed herkende dan dat van mijn man.

Echt bizar! Soms zit het ‘m ook in de manier waarop de algoritmen zelf zijn ontworpen, of in de interpretatie van de resultaten.

V: Hoe kan ik als gebruiker controleren of een AI-systeem bevooroordeeld is?

A: Goede vraag! Het is lastig, want je kunt vaak niet in de ‘black box’ van een AI-systeem kijken. Wat je wel kunt doen, is kritisch zijn op de resultaten.

Probeer het systeem uit met verschillende soorten input, bijvoorbeeld foto’s van mensen met diverse achtergronden of teksten over verschillende onderwerpen.

Als je merkt dat het systeem consequent slechter presteert voor bepaalde groepen, dan is dat een teken aan de wand. Lees ook reviews en nieuwsberichten over het systeem, misschien hebben andere mensen al biases ontdekt.

En wees alert op “confirmation bias”: als je zelf al een bepaald idee hebt, ben je sneller geneigd om bewijs te zien dat dat idee bevestigt. Vraag dus ook de mening van anderen!

Stel dat je bijvoorbeeld een hypotheekaanvraag doet via een AI-systeem, en je krijgt een afwijzing. Vraag dan om een uitleg en controleer of de argumenten wel steek houden, en of er geen sprake is van discriminatie.

V: Wat zijn concrete stappen die bedrijven kunnen nemen om AI-biases te verminderen?

A: Nou, daar kunnen bedrijven echt een verschil maken! Allereerst: zorg voor een divers team dat de AI-systemen ontwikkelt en test. Verschillende perspectieven zijn cruciaal om biases te herkennen.

Ten tweede: wees heel kritisch op de data. Is de data representatief voor de doelgroep? Zijn er genoeg voorbeelden van minderheidsgroepen?

Zo niet, ga op zoek naar meer data of gebruik technieken zoals “data augmentation” om de data te verbeteren. Ten derde: monitor de prestaties van het AI-systeem continu.

Kijk niet alleen naar de gemiddelde prestaties, maar ook naar de prestaties per groep. En als je biases ontdekt, wees dan bereid om het systeem aan te passen, ook al kost dat tijd en geld.

Denk bijvoorbeeld aan het ontwikkelen van een AI-systeem voor het beoordelen van sollicitatiebrieven. Als blijkt dat het systeem vrouwen systematisch lager beoordeelt, dan moet je echt terug naar de tekentafel.

Bedrijven zouden ook transparant moeten zijn over hoe hun AI-systemen werken en welke maatregelen ze nemen om biases te voorkomen. Dat schept vertrouwen bij de gebruikers!

📚 Referenties

Wikipedia Encyclopedia

구글 검색 결과

구글 검색 결과

구글 검색 결과

구글 검색 결과

구글 검색 결과